Autonome wapens: waarom we ons zorgen moeten maken

Autonome wapens lijken iets dat rechtstreeks uit science fiction komt. Schijn bedriegt. Autonome wapens zijn al veel slimmer dan de mechanische mijnen en automatische machinegeweren uit de twintigste eeuw. En, we ain’t not seen anything yet.

Autonome wapens

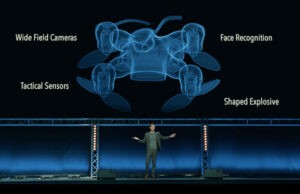

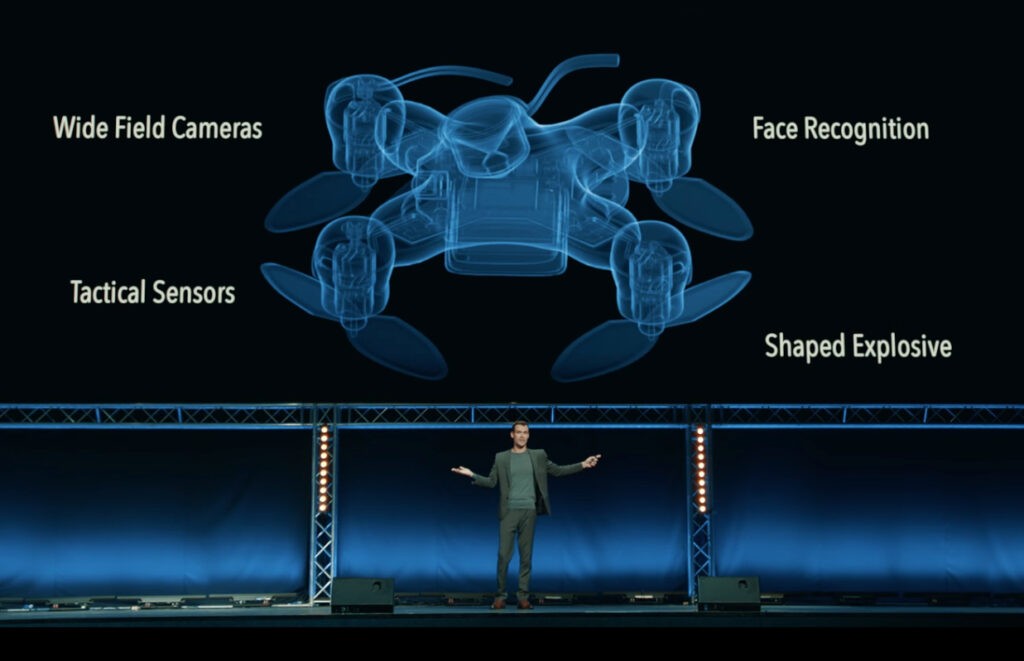

De oppositie wordt steeds actiever en het brute regime begint zich zorgen te maken. Maar dan komt de “redding” per militair transportvliegtuig. De beloofde zending voor de dictator komt aan: een vracht met drones. Speelgoed? Dat lijkt het, maar is het allerminst. Dan wordt de AI die ze bestuurt, geladen met de gezichten van duizenden leden van de oppositie. Vervolgens daalt de zwerm neer op de opstandige stad en zaait dood en verderf…

Science fiction? Nog wel, maar zowel het Pentagon als de Russen en het Chinese PLA zijn actief onderzoek aan het doen naar de inzet van autonome wapens. Hun militaire nut is te groot om niet te negeren.

TrueNorth in autonome wapens

Het verontrustende scenario dat hierboven is geschetst is nu al technisch haalbaar. IBM ontwikkelde TrueNorth, een chip met neuraal netwerk die in staat is om snel gezichten te herkennen bij een laag energiegebruik, en dus in een drone ingezet kan worden om deze gezichtsherkenning toe te laten passen[1]. Het is een kwestie van tijd voordat iemand van het Pentagon, of een militaire contractor, een bestelling bij IBM gaat doen voor miljoenen van deze chips. Of bij de Chinese concurrent. De gevolgen zijn dan vervelend.

Niet iedereen is het hier mee eens. Paul Scharre denkt dat tegenwoordige techniek voldoende is om deze killer drones tegen te houden[2], maar houdt geen rekening met de inzet van deze technologie door een weinig scrupuleuze state actor als bijvoorbeeld Turkije of Noord-Korea. Nu al behaalde Turkije een beslissende overwinning in de oorlog (via proxy Azerbeidzjan) tegen Armenië door de inzet van drones. Verdediging tegen een wapen dat gebruik kan maken van alle drie dimensies om aan te vallen en voor lage kosten in enorme aantallen verkrijgbaar is, is extreem lastig. Vooral omdat overheden hier nauwelijks op voorbereid zijn.

Ban Autonomous Weapons

Hieronder een video van hopelijk niet de nabije toekomst. Nabij is hier: voor 2025.

Bestaan autonome wapens eenmaal, dan is dat een dreiging die dodelijker kan zijn dan een kernoorlog. Dat stelt de actiegroep Ban Autonomous Lethal Weapons. Wij mensen zullen dan veranderen in opgejaagd wild. Een prooi voor een ieder achter de knoppen van een zwerm killer drones.

De petitie tekenen tegen killerbots en -drones kan hier. Aanrader.

Bronnen

1. Nicole Hemsworth, A Rare Peek into IBM’s True North Neuromorphic Chip, NextPlatform, (2018)

2. Paul Scharre, Why You Shouldn’t Fear “Slaughterbotsâ€, IEEE Spectrum, 2017

Denken met je lichaam

Denken met je lichaam